컴퓨터 비전에서의 기계학습

- 주어진 영상에 대해 특징 벡터 추출 -> 분류기 학습 (학습 집합 생성) -> 입력 영상 분류

- 분류기(학습 모델) 종류 : 신경망, SVM, 에이다부스트, 랜덤포래스트

특징 벡터 수집 방법

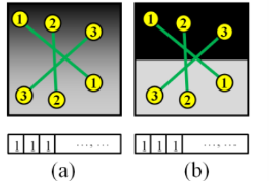

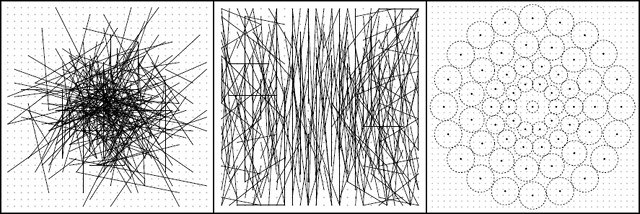

1. 일정 영역

2. 슬라이딩 윈도우

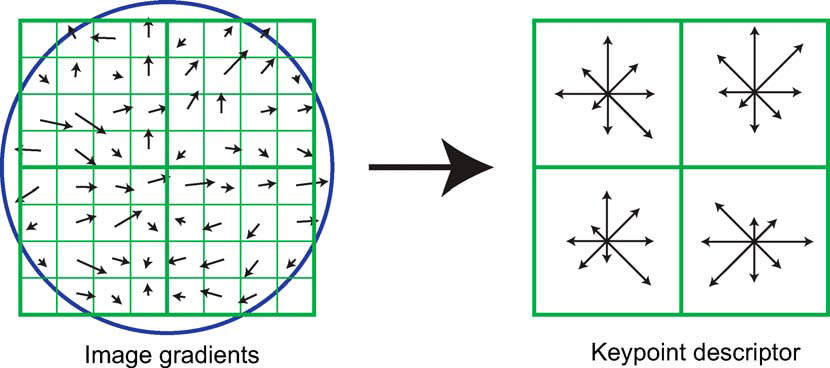

3. 특징점

신경망

- 퍼셉트론 가중치들을 나타내는 매개변수 집합이 존재

- 목적 함수 : 매개 변수들의 값이 적절한지 판단

- 학습 집합 : 최적의 매개변수를 추정하도록 사용하는 데이터

=> 매개변수가 일정 조건에 수렴할떄까지 반복

- 검증 집합 : 학습된 신경망을 검증하기 위한 데이터 집합

- 모델 선택 : 신경망 모델이 만족스럽지 못한 경우 개선된 모델 선택

- 과적합 overfitting : 신경망 학습시 아웃라이어들에도도 과하게 최적화된 상태. 일반적인 경우 잘못 분류할수 있음

성능 개선 및 평가 기법들

- 리샘플링 : 같은 샘플을 여러번 사용

- k겹 교차 검증 : 전체 샘플을 k 등분 하여, 각각의 부분집합 k-1개로 학습, 나머지 1개 부분집합으로 검증

- 부트스트랩 : 검증시 샘플의 중복을 허용함

'로봇 > 영상' 카테고리의 다른 글

| 컴퓨터 비전 - 28. 분류 앙상블 (0) | 2020.07.31 |

|---|---|

| 컴퓨터 비전 - 27. SVM (0) | 2020.07.31 |

| 컴퓨터 비전 - 25. 기하 정렬과 매칭 (0) | 2020.07.31 |

| 컴퓨터 비전 - 24. kd 트리를 이용한 매칭 (0) | 2020.07.31 |

| 컴퓨터 비전 - 23. ROC 곡선과 매칭 전략 (0) | 2020.07.31 |