그리스어 표기

http://blog.naver.com/PostView.nhn?blogId=5002sesang&logNo=40019793977&parentCategoryNo=&categoryNo=4&viewDate=&isShowPopularPosts=true&from=search

http://blog.naver.com/PostView.nhn?blogId=5002sesang&logNo=40019793977&parentCategoryNo=&categoryNo=4&viewDate=&isShowPopularPosts=true&from=search

고유치 eigen value, 고유벡터 eigen vector

- 패턴 인식 + 전기 + 사회 과학 분야 전반에서 사용되는 분석 도구

- 행렬의 중요한 특징을 표현

- 아래의 식을 만족하는 벡터 A가 eigen vector, 스칼라 lambda는 고유치

양의 정부호 행렬

- 0이 아닌 벡터 x와 행렬 A가 다음의 조건을 만족하는 경우

=> 행렬 A는 양의 정부호 행렬 positive definite matrix

=> A > 0 이 A가 정부호 임을 알려줌

양의 준정부호 행렬

- 0이 아닌 벡터 x와 행렬 A가 다음 조건 만족

=> 행렬 A는 양의 준정부호행렬 positive semi-definite matrix

=> A >= 0. 즉, A는 준정부호

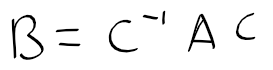

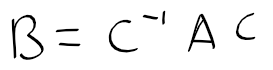

유사 변환 similarity transformation과 고유치

- 유사 변환 = 강체 변환(평행 이동 + 회전) + 스케일 변환

- 다음의 조건을 만족하는 역행렬 C가 존재하면 행렬 A와 B는 유사

- 유사 변환 행렬들은 동일한 고유치를 가짐

대각화 가능한 행렬 digonalizable

- 아래의 조건을 만족하는 대각행렬 C가 존재할때, 정방 행렬 A는 대각화 가능한 행렬

* 이후 특이값 분해를 위해 대각화가 가능하여야 함

행렬의 대각화

- 대각 행렬 C가 아래와 같은 열벡터 v들을 모아 만든 행렬이라고 가정할때

- 정방 행렬 A의 고유치, 고유벡터들을 행렬 A와 행렬C의 곱으로 표현 가능

- 행렬 C는 선형 독립 -> 비특이 행렬 => C의 역행렬이 존재한다.

=> 행렬 A는 대각화가 가능함

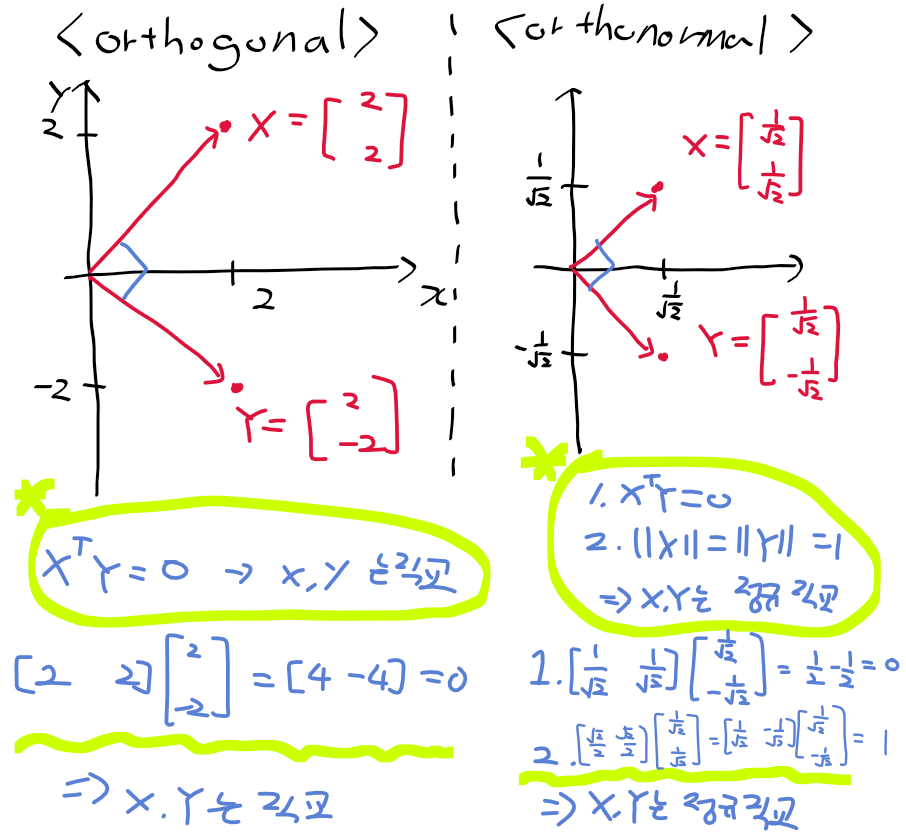

직교 대각화 orthogonal diagonalization

- 직교 행렬의 성질 : 대각 행렬 C가 직교행렬인 경우 C의 전치행렬 = C의 역행렬

- 직교 행렬의 성질을 이용하면 역행렬을 전치행렬로 변환하여 간단하게 계산 가능

특이값 분해 singular value decomposition

- 복습 => 특이 행렬 : 역행렬이 존재하지 않음. 비특이 행렬 : 역행렬이 존재

- 특이 값 분해

: 특이값 분해(SVD)는 고유값 분해(eigen value decomposition)처럼 행렬을 대각화하는 한 방법

=> 특이 행렬(비정방행렬)에서 특이값(고유값)들에 대한 대각 행렬을 분해한다.

- 특이값 분해의 장점

: 행렬이 정방행렬이든 아니든 관계없이 모든 m x n 행렬에 대해 적용 가능하기 때문이다.

- 비정방 행렬 A가 주어질때 다음의 관계가 이루어짐.

고유값 분해 eigen value decomposition과 특이값 분해 Singular Value Decomposition의 차이

- 고유값 분해는 정방행렬 A의 고유값들을 대각행렬로 추출

- 특이값 분해는 비정방행렬들의 특이값(행렬의 특성을 가장 잘나내는 값)을 대각행렬로 추출

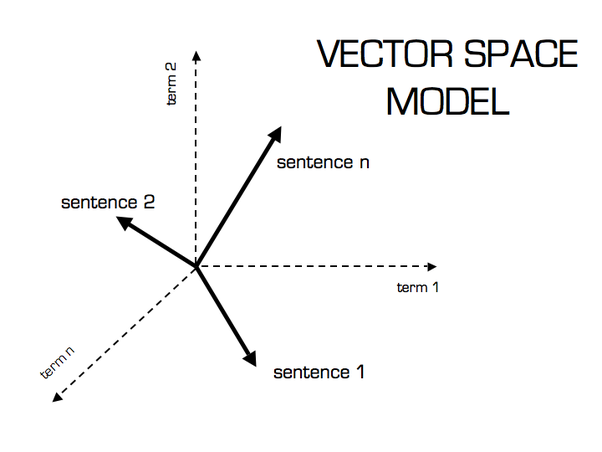

선형 변환 linear transform

- 아래와 같이 서로 다른 차원의 벡터 공간에서 변환(맵핑)을 의미

- 아래의 예시는 2차원 벡터공간 X에서 3차원 벡터공간 Y로의 선형 변환을 보여줌

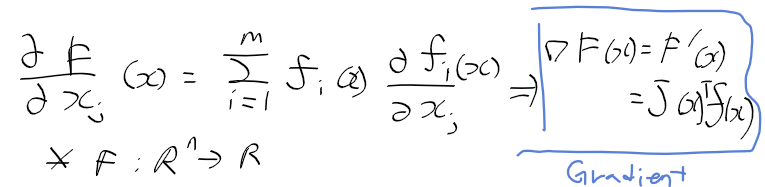

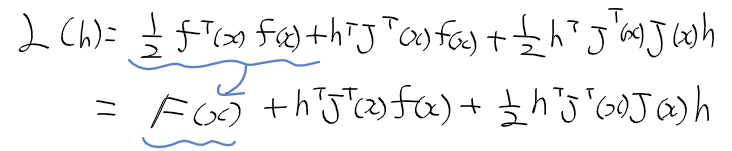

- 선형 변환을 행렬로 표기하면 아래와 같다.